|

Главная |

ПЕРСПЕКТИВЫ РАЗВИТИЯ АРМ

|

из

5.00

|

Дальнейшее развитие АРМ связано с:

- использованием новых технических средств,

- разработкой нового базового и прикладного программного обеспечения,

- развитием технологии автоматизированного проектирования,

- объединением АРМ в иерархические и сетевые структуры.

Широкое распространение получают профессиональные персональные ЭВМ с использованием процессоров 386 и 486 и специализированных, а также соответствующего программного обеспечения.

Параметры новых АРМ:

- быстродействие - 5-10 млн.оп/сек,

- объем внешней памяти - до 500 Мбайт,

- скорость обмена информацией по каналам связи - свыше 2 Мбайт/сек.

Рабочие места будут оборудованы цветными графическими дисплеями с регенерацией или растровыми с размерами экрана до 50 см по диагонали и проекционных с площадью экранов в несколько квадратных метров.

Базовое программное и лингвистическое обеспечения должны включать в себя:

- средства создания многомашинных сетевых и иерархических структур;

- мониторную систему;

- операционную систему реального времени;

вязанных друг с другом АРМами по разработке логики и схемотехники БИС, топологии БИС и печатных плат, конструкций узлов и блоков изделий РЭА.

КОМПЛЕКСИРОВАНИЕ ТЕХНИЧЕСКИХ СРЕДСТВ САПР

Комплектование технических средств САПР производится на основе следующих требований:

- полноты,

- унификации,

- расширяемости,

- резервируемости,

- экономичности разработки и эксплуатации,

- эксплуатационного удобства и технологичности.

Полнота технических средств означает наличие в САПР набора технических средств всех групп для выполнения операций по всему циклу автоматизированного проектирования.

Унификация технических средств означает использование однотипных единиц оборудования для выполнения одних и тех же функций на различных уровнях САПР.

Расширяемость (открытость) технических средств означает возможность количественных и качественных изменений в составе технических средств по изменению требований к производительности и степени автоматизации проектирования, а также появления новых более совершенных типов оборудования.

Резервируемость технических средств реализуется дублированием тех или иных средств и позволяет снизить влияние их сбоев и отказов на функционирование САПР. Избыток технических средств не только повышает живучесть САПР, но и является обязательным условием успешной обработки потока задач, интенсивность которого изменяется во времени.

Экономичность разработки технических средств позволяет удешевить создание и внедрение САПР за счет последовательного многоэтапного ввода оборудования и наращивания мощности САПР с небольшим опережением относительно роста текущих потребностей.

Экономичность эксплуатации технических средств позволяет снизить непроизводительные потери за счет сочетания режимов реального времени с пакетной обработкой, коллективного использования рабочих мест.

Эксплуатационное удобство технических средств позволяет увеличить производительность разработчика и снизить уровень ошибок при взаимодействии оператора с ЭВМ за счет совершенства программно-аппаратного обеспечения.

Технологичность технических средств характеризуется степенью соответствия состава оборудования перечню проектных операций, свойственных применяемой технологии проектирования заданного объекта.

В соответствии с этими требованиями в последнее время признаны наиболее целесообразными САПР из унифицированных модулей. Они имеют достаточно развитые технические и базовые программные средства. В составе периферийных модулей широкое распространение получили "интеллектуальные терминалы" и "инженерные графические станции", создаваемые на основе микропроцессорных вычислительных средств.

Выводы:

1. Рассмотрены назначение, структура САПР, технические средства.

2. Рассмотрены назначение, структура автоматизированных мест проектировщиков и их возможности по созданию аппаратуры.

3. Определены перспективы развития технических средств автоматизированного проектирования.

НЕЙРОСТРУКТУРЫ

ВВЕДЕНИЕ

Теоретические основы нейросетевого подхода к изучению процессов переработки информации в мозге были заложены Маккалоком и Питтсом .Они изучили модельную нейронную сеть, представляющую

собой совокупность элементов( названных формальными нейронами),обменивающихся между собой информацией с помощью направленных связей. Каждый из формальных нейронов представляет собой простой процессор, осуществляющий суммирование сигналов, которые поступают на его входы. Его состояние характеризуется внутренней переменной , принимающей значение 0 ( пассивное состояние), если сумма сигналов на входах меньше фиксированного порога, и 1 ( активное состояние, в котором нейрон способен посылать сообщения другим нейронам в сети ), если указанная сумма превышает порог. Авторами

показано, что сеть таких нейроподобных элементов в принципе способна выполнять различные логические функции и по своей вычислительной мощности сопоставима с вычислительными машинами фон

неймановского типа.

Позднее Ф. Розенблатт предложил архитектуру нейронной сети, получившую название персептрона . Это вызвало большой интерес, поскольку открывалась возможность создания технических устройств, способных решать интеллектуальные задачи, такие как распознавание образов.

Основным элементом персептрона является пороговый вентиль, аналогичный формальному нейрону Мак-Коллака и Питтса. Он осуществляет суммирование с определенными весами сигналов, поступающих

от других нейронов, и переходит в состояние логической единицы(или наоборот, нуля), если эта сумма превышает пороговое значение.

В последние годы наблюдается рост активности в области теории и технической реализации искусственных нейронных сетей, в идейном отношении близких к персептрону Розенблатта. В работах Андерсона, Гроссберга, Кохонена, Хопфилда и др., выполненных в конце 70-х - начале 80-х годов, были разработаны более сложные и гибкие архитектуры сетей, составленных из нейроподобных элементов, и изучены функциональные возможности таких систем. Следует отметить, что этот процесс происходил на фоне общего возрастания интереса к многопроцессорным системам(к которым относятся в том числе и нейронные сети) и к реализации на них параллельных процессов обработки информации. Сочетание в архитектуре нейронных

сетей массированного параллелизма при обработке информации с использованием элементов-связей ( аналогов синапсов в биологии ) на стадии обучения системы выделило нейронные сети в самостоятельный

класс многопроцессорных вычислительных устройств.

Здесь рассмотрим основные архитектуры нейронных сетей, их общие и функциональные свойства и наиболее распространенные алгоритмы обучения сетей.

ОСНОВНЫЕ АРХИТЕКТУРЫ И ОСОБЕННОСТИ

На рис.1 приведена классификация нейросетевых систем.

Рис.1. Диаграмма, иллюстрирующая связь нейросетевых структур с многопроцессорными архитектурами.

FAN - процессор с распространением возбуждения.

Среди признаков, отличающих нейронные сети, часто называют массированный параллелизм при вычислениях, а также возможность программирования сетей путем обучения или адаптации. Выделяют

также локальность памяти каждого из нейронов.

ЭЛЕМЕНТЫ ИСКУССТВЕННЫХ НЕЙРОННЫХ СЕТЕЙ - НЕЙРОНЫ И СВЯЗИ

Нейронная сеть представляет собой совокупность элементов двух типов-процессоров, называемых нейронами, и элементов ( в общем случае также процессоров) - называемых связями между нейронами.

Нейрон - процессор специального вида, который имеет один выход и некоторое число входов (N) (рис.2.). Как правило, предполагается, что все нейроны выполняют одинаковую, сравнительно простую функцию

( либо существует небольшое число типов нейронов с различными функциями), например, сложение величин сигналов  , i = 1,...,N , поступающих на его входы ( возможно, с некоторыми весами

, i = 1,...,N , поступающих на его входы ( возможно, с некоторыми весами  ). Выходной сигнал нейрона определяется с помощью суммы i вида

). Выходной сигнал нейрона определяется с помощью суммы i вида

= g [

= g [  ] ,

] ,

где g - нелинейная функция, определенная для каждого типа нейрона, О - порог. Пороговому элементу

i Маккалока и Питтса соответствует функция g(x), имеющая вид ступеньки ( рис.3.а)

g(x) = O (x) , O(x) =  .

.

Для моделирования некоторых нейроподобных элементов подходит функция, представленная на рис.3 г, вида g(x) = 1 - O (x).Нелинейные функции более общего вида, в которых переходная область имеет конечную ширину а , изображены на рис.3. б и в. Нейроны такого типа удобны для моделирования аналоговых нейронных сетей.

Рис.3. Примеры нелинейных функций отклика нейронов, используемых для моделирования сетей.

Между каждыми двумя нейронами в сети ( с номерами i и j)могут быть установлены две направленные связи: (ij) и (ji) (рис.4).В некоторых случаях, например в модели Хопфилда, эти связи считаются равными. Каждой связи в сети присваивается вес  . Это можно выполнить двумя способами. В первом случае считается , что собственно связи между нейронами представляют собой пассивные проводники, параметры которых неизменны. В процессе обучения изменяются веса

. Это можно выполнить двумя способами. В первом случае считается , что собственно связи между нейронами представляют собой пассивные проводники, параметры которых неизменны. В процессе обучения изменяются веса  ( см. рис.1 ), с которыми суммируются входные сигналы на каждом нейроне. При этом нумерация входов всех нейронов предполагается согласованной с нумерацией нейронов в сети. При втором способе все входы в нейрон предполагаются эквивалентными, при обучении изменяются свойства связей ( например, их сопротивления, емкости или коэффициенты усиления входящих в них усилителей ). С точки зрения математического моделирования эти способы могут не различаться. Однако при технической реализации в зависимости от используемой технологии может оказаться предпочтительней один из указанных способов. Например, пороговый вентиль относится

( см. рис.1 ), с которыми суммируются входные сигналы на каждом нейроне. При этом нумерация входов всех нейронов предполагается согласованной с нумерацией нейронов в сети. При втором способе все входы в нейрон предполагаются эквивалентными, при обучении изменяются свойства связей ( например, их сопротивления, емкости или коэффициенты усиления входящих в них усилителей ). С точки зрения математического моделирования эти способы могут не различаться. Однако при технической реализации в зависимости от используемой технологии может оказаться предпочтительней один из указанных способов. Например, пороговый вентиль относится

к первому типу, а сеть из аналоговых усилителей с насыщением - ко второму.

ТИПЫ АРХИТЕКТУР

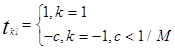

а) Сети Хопфилда

Модель, предложенная Хопфилдом, относится к типу бинарных (или как вариант, биполярных, когда, переменная, описывающая внутреннее состояние нейронов, может принимать и отрицательное значение, например +1 и -1), а ее обучение представляет собой вариант обучения с супервизором. Она основывается на некоторых аналогиях с физическими системами, в частности, со спиновыми стеклами , а также с нелинейными динамическими системами, обладающими подходящей структурой аттракторов в фазовом пространстве. Каждый такой аттрактор может рассматриваться как отдельная запись информации ( образа ) в памяти системы. Релаксация системы из произвольного начального состояния ( имеющего смысл предъявленного

стимула) к устойчивой точке представляет собой физическую аналогию восстановления информации по достаточной ее части - распознавания образов.

В модели Хопфилда состояние системы описывается N -мерным вектором V = (  ), где

), где

= 0 или 1 - описывает состояние i-го нейрона. Состояние системы, которому соответствует

= 0 или 1 - описывает состояние i-го нейрона. Состояние системы, которому соответствует

одна из вершин единичного гиперкуба в N- мерном пространстве, меняется во времени по следующему алгоритму. Каждый нейрон изменяет свое состояние в случайный момент времени со средней скоростью w так, что в следующий момент случайно выбранный элемент с номером i принимает значения

= 1, если

= 1, если  и

и

= 1, если

= 1, если  (2)

(2)

Здесь  - порог срабатывания i-го нейрона. В дальнейшем, как правило, предполагается, что

- порог срабатывания i-го нейрона. В дальнейшем, как правило, предполагается, что  для всех i либо

для всех i либо  =1/2

=1/2  .

.

В последнем случае выбор порогов соответствует переходу к "биполярным" нейронам, состояния которых описываются спиновыми переменными  . Поэтому в большинстве случаев можно

. Поэтому в большинстве случаев можно

просто говорить о моделях (0,1) и (+_1), определяя тем самым возможные состояния элементов при нулевых порогах.

Для хранения образов памяти  , s= 1,..., n используется матрица связей следующего вида:

, s= 1,..., n используется матрица связей следующего вида:

, i-=j ,

, i-=j ,  (3)

(3)

В такой сети воздействие на i-нейрон будет определяться выражением для "силы"( являющейся аналогом мембранного потенциала в нейробиологии)

i-=j,  = 0.

= 0.

Для случайно выбранных векторов  среднее значение члена в скобках равно нулю, если s-=s'. Тогда справедливо выражение:

среднее значение члена в скобках равно нулю, если s-=s'. Тогда справедливо выражение:

принимает положительные значения при

принимает положительные значения при  = 1 и отрицательные при

= 1 и отрицательные при  =0.

=0.

Поэтому при пренебрежении шумом, даваемым членами с s-=s', состояние образов памяти  устойчиво

устойчиво

( во всяком случае , при n < N ). Возможно появление дополнительных устойчивых состояний сети, не совпадающих с векторами памяти - "ложные образы ".

Динамика нейронной сети, описываемая уравнениями (2)-(3), имеет в качестве аттракторов только устойчивые стационарные точки. В случае симметричной матрицы Т в системе возможно наличие

большого числа стационарных состояний. Теория дискретных сетей Хопфилда получила в последнее время

значительное развитие. Возможность введения функции, имеющей смысл энергии, уменьшающейся в процессе релаксации начального состояния системы, позволила применить для исследования системы

хорошо разработанный аппарат статистической физики. В частности, введение сопряженной к энергии величины - эффективной "температуры" - позволило исследовать структуру устойчивых состояний и воз-

можности их изменения в процессе обучения .

Возможна реализация нейронной сети на аналоговых элементах (операционных усилителях). Это позволяет использовать их для решения задач комбинаторной оптимизации, коммивояжере, задаче о

раскраске карт, задаче оптимизации размещения электронных элементов на чипе.

б) СЕТЬ КОСКО

Коско предложил модель нейронной сети с синхронной динамикой, которая получила название двунаправленной ассоциативной памяти ( bidirectional associative memory, BAM). Она представляет инте-

рес для оптических реализаций нейронных сетей. В этой модели вся совокупность нейронов разделена на подмножества ( вообще говоря, различной мощности) - А и В . Сеть устроена таким образом, что

выходы нейронов подсети А связаны с входами нейронов подсети В и наоборот( см. рис. ). Матрица связей  строится по правилу:

строится по правилу:

оно имеет вид суммы прямых произведений векторов памяти

Рис. Схема модели двунаправленной ассоциативной памяти Коско.

Динамика этой системы описывается парой уравнений

,

,

.

.

Так же, как и в случае модели Хопфилда, для ВАМ единственными аттракторами в фазовом пространстве являются устойчивые стационарные точки, называемые парой (  ). Эти точки достигаются

). Эти точки достигаются

из произвольного начального состояния - пары векторов (  ).

).

Имеются модификации нейронной сети Коско:

- за счет введения матриц связи общего вида ( ассиметричных, удовлетворяющих принципу "детального баланса"),

- за счет введения ненулевых порогов, что позволяет увеличить число устойчивых состояний системы ( их число в общем случае N находится между 1 и 2 ).

В) ХЕММИНГОВА СЕТЬ

Хеммингова сеть представлена на рис. .

Она состоит из двух частей. Нижняя подсеть служит для формирования по входу - бинарному вектору длиной N - начального состояния для нейронов верхней подсети. Число нейронов в ней M.

Веса связей  для нижней подсети и

для нижней подсети и  для верхней, а также пороги

для верхней, а также пороги  для нижней подсети устанавливаются по следующим правилам:

для нижней подсети устанавливаются по следующим правилам:

,

,  = N/2 , i=1,...,N , j=1,..., M, (4)

= N/2 , i=1,...,N , j=1,..., M, (4)

.

.

Пороги для верхней подсети устанавливаются равными нулю. В выражении (4)  - i-ый элемент j-го вектора памяти (число нейронов в среднем слое M совпадает с числом записанных образов).

- i-ый элемент j-го вектора памяти (число нейронов в среднем слое M совпадает с числом записанных образов).

Рис. Схематическое изображение хемминговой сети.

В данной сети выполняются итерации для нейронов верхней подсети

при начальном условии

.

.

Функция g в этих выражениях соответствует рис.3б, причем динамика чувствительна к выбору величины переходной области а. Процесс итераций продолжается до тех пор, пока выходы всех нейронов,

за исключением одного, не станут отрицательными.

Имеется другое название сети Хемминга - сеть с латеральным торможением ( явление латерального торможения широко распространено в нейрофизиологии).

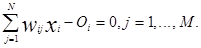

г) ПЕРЦЕПТРОНЫ

Простейший персептрон состоит из одного слоя нейронов, соединенных связями с N входами. Соответствующая схема представлена на рис. .

Веса связей обозначены  , i=1,...,N , j=1,...,M (M - число нейронов - пороговых элементов в слое). Каждый из нейронов осуществляет нелинейное преобразование сигналов, поступающих на его вход, согласно выражению (1)

, i=1,...,N , j=1,...,M (M - число нейронов - пороговых элементов в слое). Каждый из нейронов осуществляет нелинейное преобразование сигналов, поступающих на его вход, согласно выражению (1)

, (6)

, (6)

где g - пороговая функция, изображенная на рис.3а,  - входные значения,

- входные значения,  = 0,1 - переменные характеризующие выходы нейронов. Переменные

= 0,1 - переменные характеризующие выходы нейронов. Переменные  могут принимать произвольные значения ( в частности, могут быть аналоговыми). Согласно ( 6 ), персептрон разделяет все N -мерное пространство входных переменных {

могут принимать произвольные значения ( в частности, могут быть аналоговыми). Согласно ( 6 ), персептрон разделяет все N -мерное пространство входных переменных {  } на классы посредством гиперплоскостей. Они определяются уравнениями вида:

} на классы посредством гиперплоскостей. Они определяются уравнениями вида:

Может существовать не более 2 таких классов. Веса связей и пороги могут быть фиксированными либо изменяться адаптивно. Простейший алгоритм адаптации был предложен Розенблаттом.

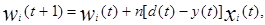

Рассмотрим случай, когда М=1.

В этом случае персептрон осуществляет разбиение множества всех входов на два класса

A ( y= +1 ) и B ( y= -1 ). Модификация весов связей  (j= 1 ) производится после каждого вычисления

(j= 1 ) производится после каждого вычисления

выхода нейрона в соответствии с выражением ( 6 ) при подаче на вход сети очередного вектора обучающей выборки:

где 0 < n <= 1, y (t) - состояние выхода нейрона при входном векторе x(t), для которого желаемым вектором является d(t). Если выход совпадает с желаемым вектором, связи не изменяются.

Розенблатт показал, что если входные векторы , принадлежащие поочередно одному из двух классов, разделимы в пространстве входов некоторой гиперплоскостью, то указанный алгоритм сходится.

Недостатком простых однослойных персептронов является невозможность построить сложную разделяющую гиперповерхность в пространстве входов. Для того, чтобы это сделать, используют более

сложные модели - многослойные персептроны ( см. рис. ). В этих моделях вводятся "скрытые" слои нейронов, элементы которых не связаны непосредственно с входами и выходами системы.

Двухслойные персептроны позволяют формировать выпуклые оболочки в пространстве входов

(отвечающие тому или иному классу).

Трехслойные персептроны дают возможность построить области произвольной сложности. При этом ограничение только на число используемых в сети нейронов.

Однако, обучение таких сетей является весьма трудоемким процессом и для формирования необходимых матриц связей необходимо применять специальные алгоритмы.

|

из

5.00

|

Обсуждение в статье: ПЕРСПЕКТИВЫ РАЗВИТИЯ АРМ |

|

Обсуждений еще не было, будьте первым... ↓↓↓ |

Почему 1285321 студент выбрали МегаОбучалку...

Система поиска информации

Мобильная версия сайта

Удобная навигация

Нет шокирующей рекламы